YOLO Drone Detection Dataset|无人机检测数据集|YOLO数据集

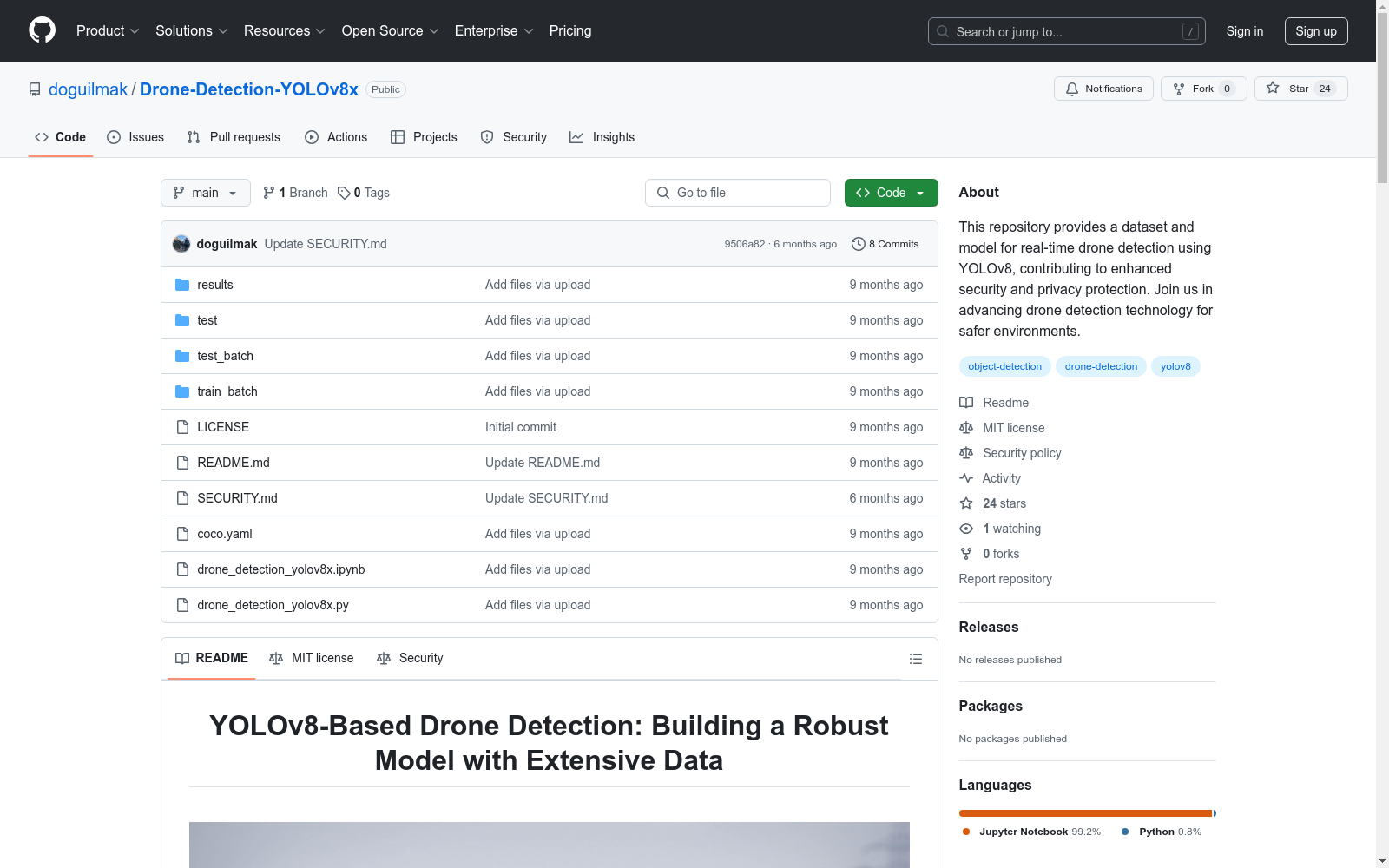

收藏YOLOv8-Based Drone Detection: Building a Robust Model with Extensive Data

摘要

无人机(UAV)在监控、摄影和配送服务等领域的应用越来越广泛。然而,无人机的快速普及引发了安全和隐私威胁的担忧。为了解决这些问题,实时识别和跟踪无人机的有效检测系统至关重要。在本研究中,我们提出了一个全面的数据集,并使用YOLOv8架构提出了一个先进的无人机检测模型。

引言

无人机的广泛采用导致了可靠无人机检测系统的迫切需求,以确保公共场所的安全。由于无人机的小尺寸、快速移动和多样化的外观,传统的目标检测方法不足。因此,需要能够准确识别复杂环境中无人机的高级检测模型。

数据集

为了促进无人机检测模型的开发和评估,我们引入了一个新颖且全面的数据集,专门为训练和测试无人机检测算法而精心策划。该数据集来自Kaggle上的公开可用YOLO Drone Detection Dataset,包含在各种环境条件和相机视角下捕获的多样化标注图像。数据集包括无人机实例以及其他常见物体,以实现鲁棒的检测和分类。

方法论

在本研究中,我们采用YOLOv8架构,这是一个流行且高效的目标检测框架,用于无人机检测。YOLOv8,即“You Only Look Once”版本8,使用单个神经网络同时预测图像中多个物体的边界框和类别概率。该架构提供实时性能,非常适合无人机检测应用。

实验设置

为了训练和评估我们的无人机检测模型,我们利用Colab平台,这是一个提供强大计算资源和深度学习库的云环境。利用Colab的GPU加速能力,我们使用我们精心策划的数据集训练YOLOv8模型,并微调其参数以优化检测准确性和效率。

YOLO

- 单次检测:YOLO采用与使用区域提议技术的传统目标检测方法不同的方法。YOLO不是将图像分割成区域并分别检查每个区域,而是单次通过进行检测。它将输入图像分割成一个网格,并为每个网格单元预测边界框和类别概率。

- 基于网格的预测:YOLO将输入图像分割成固定大小的网格,通常是7x7或13x13。每个网格单元负责预测落入其中的物体。对于每个网格单元,YOLO预测多个边界框(每个边界框都有一个置信度分数)和类别概率。

- 锚框:为了处理不同大小和宽高比的物体,YOLO使用锚框。这些锚框是预定义的不同形状和大小的框。每个锚框与特定的网格单元相关联。网络预测相对于网格单元的锚框的偏移量和尺寸,以及置信度分数和类别概率。

- 训练:YOLO使用标注的边界框注释和分类标签的组合进行训练。训练过程涉及优化网络以最小化定位损失(与边界框预测的准确性相关)和分类损失(与类别预测的准确性相关)。

- 速度和准确性权衡:YOLO通过牺牲一些定位准确性来实现实时目标检测,相比于Faster R-CNN等较慢的方法。然而,它仍然实现了具有竞争力的准确性,同时提供了显著更快的推理速度,非常适合实时应用。

关键词

- 无人机检测

- YOLOv8

- 目标检测

- 深度学习

- 监控

- 安全

结果和讨论

我们展示了我们的无人机检测模型在训练和测试数据集上的全面性能结果。评估指标包括精确度、召回率和F1分数,这些是评估模型检测准确性的标准度量。此外,我们分析了模型在各种环境条件下的性能,并讨论了其优势和局限性。

结论

我们的研究通过提出一个全面的数据集和一个使用YOLOv8架构的先进检测模型,解决了可靠无人机检测系统的关键需求。我们精心策划的数据集和模型的有希望的性能为无人机检测领域提供了宝贵的贡献。本研究的结果可以为无人机可能构成潜在风险的领域提供增强的安全措施和隐私保护。