KITTI Tracking|自动驾驶数据集|多目标跟踪数据集

收藏

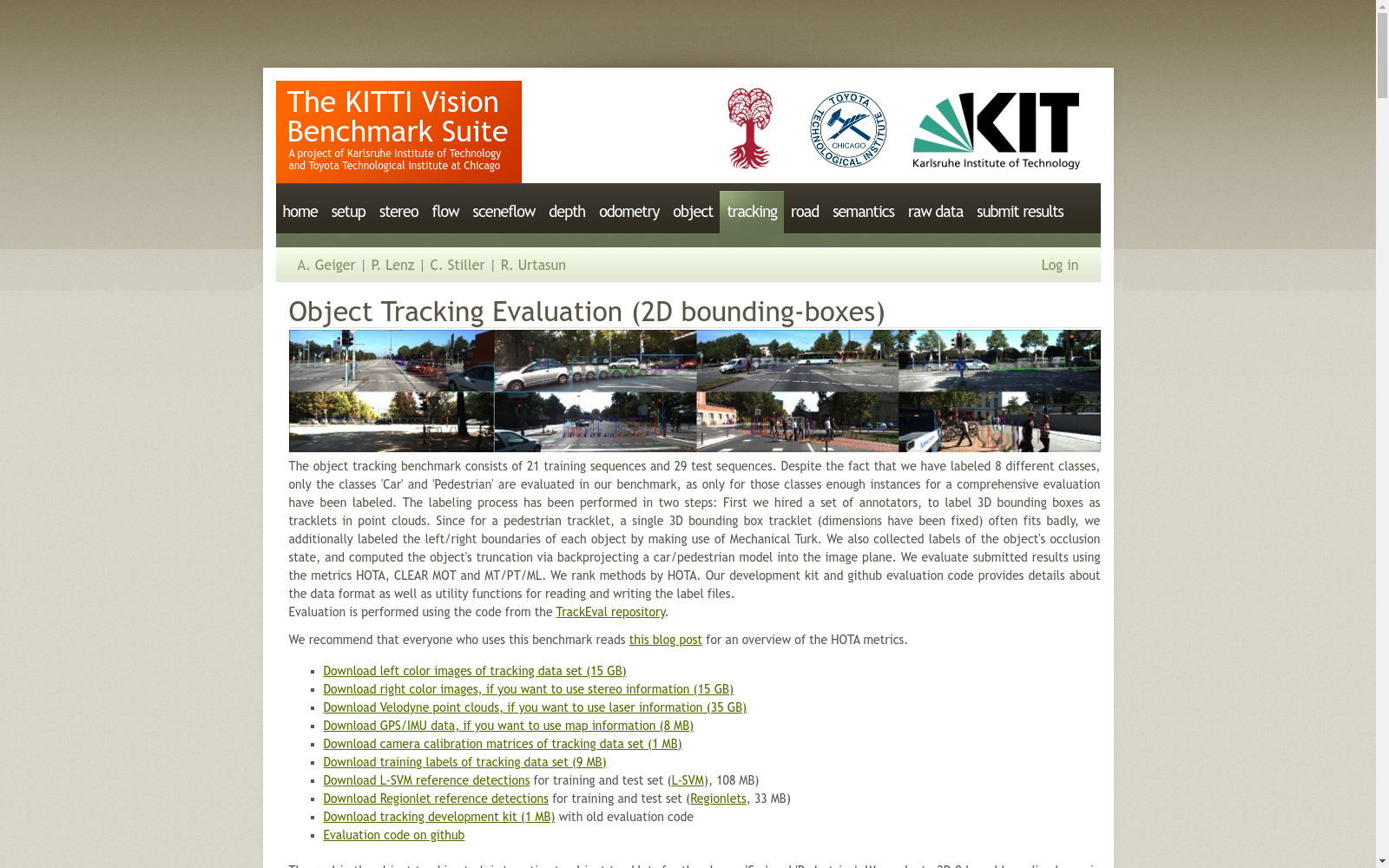

- KITTI Tracking数据集首次发表,由德国卡尔斯鲁厄理工学院和丰田美国技术研究院联合发布,旨在为自动驾驶和计算机视觉领域的研究提供基准数据。

- KITTI Tracking数据集首次应用于自动驾驶领域的研究,特别是在目标跟踪和场景理解方面,为相关算法的发展提供了重要的数据支持。

- KITTI Tracking数据集的扩展版本发布,增加了更多的场景和目标类别,进一步丰富了数据集的内容,提升了其在多任务学习中的应用价值。

- KITTI Tracking数据集在计算机视觉顶级会议CVPR上被广泛引用和讨论,成为目标跟踪和自动驾驶领域的重要基准数据集之一。

- KITTI Tracking数据集的最新版本发布,引入了更多的传感器数据和复杂的场景,以适应日益增长的自动驾驶和计算机视觉研究需求。

- 1Are we ready for Autonomous Driving? The KITTI Vision Benchmark SuiteKarlsruhe Institute of Technology · 2012年

- 2A Survey on 3D Object Detection Methods for Autonomous Driving ApplicationsUniversity of Waterloo · 2020年

- 3Multi-Task Learning Using Uncertainty to Weigh Losses for Scene Geometry and SemanticsUniversity of Cambridge · 2018年

- 4PointPillars: Fast Encoders for Object Detection from Point CloudsUber Advanced Technologies Group · 2019年

- 5End-to-End Learning of Multi-Sensor 3D Tracking by DetectionUniversity of Freiburg · 2020年

中国气象数据

本数据集包含了中国2023年1月至11月的气象数据,包括日照时间、降雨量、温度、风速等关键数据。通过这些数据,可以深入了解气象现象对不同地区的影响,并通过可视化工具揭示中国的气温分布、降水情况、风速趋势等。

github 收录

Beijing Traffic

The Beijing Traffic Dataset collects traffic speeds at 5-minute granularity for 3126 roadway segments in Beijing between 2022/05/12 and 2022/07/25.

Papers with Code 收录

FAOSTAT Agricultural Data

FAOSTAT Agricultural Data 是由联合国粮食及农业组织(FAO)提供的全球农业数据集。该数据集涵盖了农业生产、贸易、价格、土地利用、水资源、气候变化、人口统计等多个方面的详细信息。数据包括了全球各个国家和地区的农业统计数据,旨在为政策制定者、研究人员和公众提供全面的农业信息。

www.fao.org 收录

Houston2013, Berlin, Augsburg

本研究发布了三个多模态遥感基准数据集:Houston2013(高光谱和多光谱数据)、Berlin(高光谱和合成孔径雷达数据)和Augsburg(高光谱、合成孔径雷达和数字表面模型数据)。这些数据集用于土地覆盖分类,旨在通过共享和特定特征学习模型(S2FL)评估多模态基线。数据集包含不同模态和分辨率的图像,适用于评估和开发新的遥感图像处理技术。

arXiv 收录

CMNEE(Chinese Military News Event Extraction dataset)

CMNEE(Chinese Military News Event Extraction dataset)是国防科技大学、东南大学和清华大学联合构建的一个大规模的、基于文档标注的开源中文军事新闻事件抽取数据集。该数据集包含17,000份文档和29,223个事件,所有事件均基于预定义的军事领域模式人工标注,包括8种事件类型和11种论元角色。数据集构建遵循两阶段多轮次标注策略,首先通过权威网站获取军事新闻文本并预处理,然后依据触发词字典进行预标注,经领域专家审核后形成事件模式。随后,通过人工分批、迭代标注并持续修正,直至满足既定质量标准。CMNEE作为首个专注于军事领域文档级事件抽取的数据集,对推动相关研究具有显著意义。

github 收录