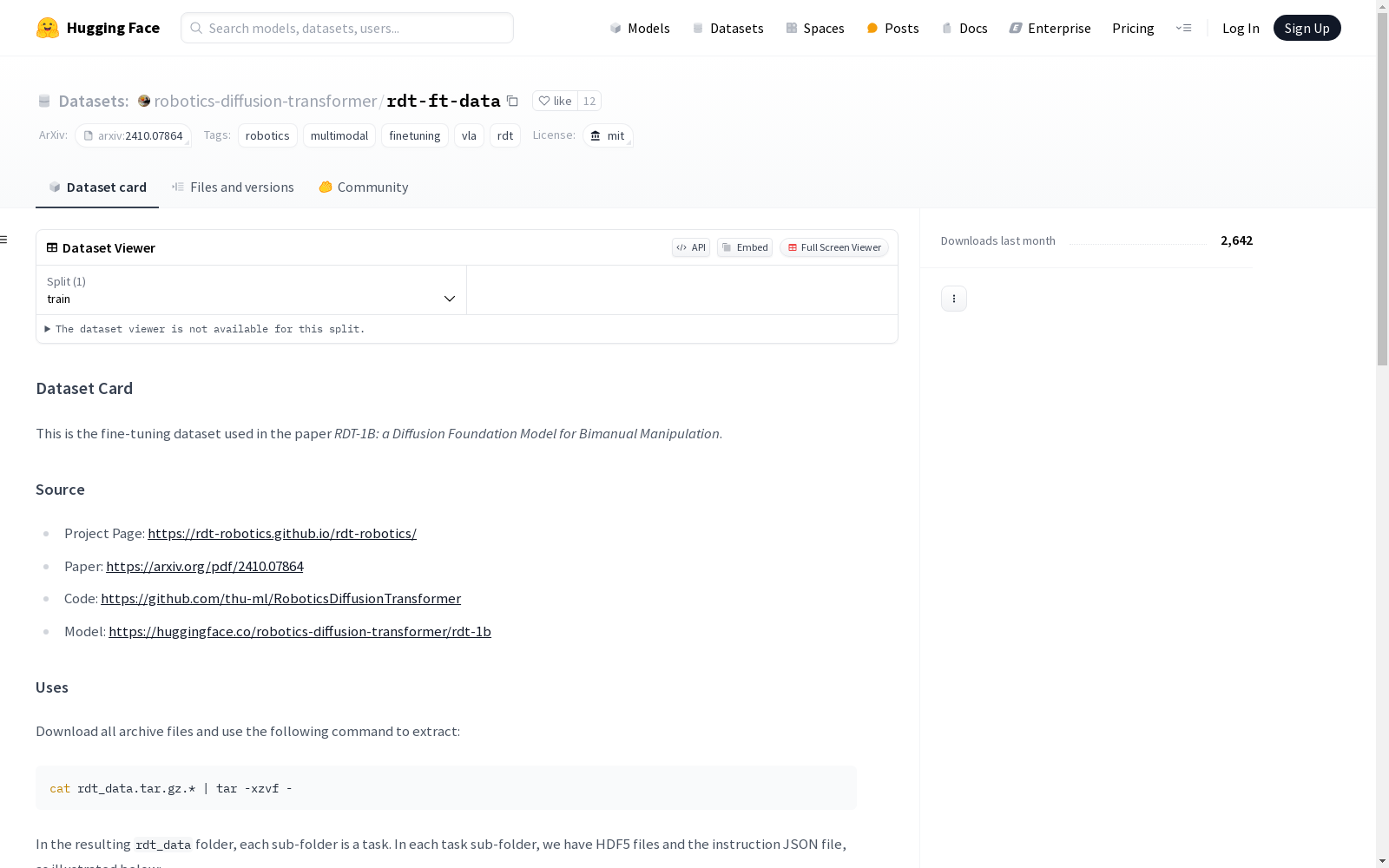

rdt-ft-data|双机械臂操作数据集|扩散模型数据集

收藏huggingface2024-10-10 更新2024-12-12 收录

下载链接:

https://huggingface.co/datasets/robotics-diffusion-transformer/rdt-ft-data

下载链接

链接失效反馈资源简介:

该数据集用于论文《RDT-1B: a Diffusion Foundation Model for Bimanual Manipulation》的微调。数据集包含多个任务子文件夹,每个子文件夹包含HDF5文件和指令JSON文件。HDF5文件记录了任务的轨迹/片段,包括两个机械臂的关节位置和图像数据。JSON文件包含任务的注释语言指令,包括原始指令、扩展指令和简化指令。

开放时间:

2024-10-07

创建时间:

2024-10-07

原始信息汇总

数据集概述

数据集信息

- 名称: RDT-FT-Data

- 许可证: MIT

- 标签:

- robotics

- multimodal

- finetuning

- vla

- rdt

数据集来源

- 项目页面: https://rdt-robotics.github.io/rdt-robotics/

- 论文: https://rdt-robotics.github.io/rdt-robotics/static/paper.pdf

- 代码: https://github.com/thu-ml/RoboticsDiffusionTransformer

- 模型: https://huggingface.co/robotics-diffusion-transformer/rdt-1b

数据集用途

- 下载与解压: 下载所有归档文件并使用以下命令解压: bash cat rdt_data.tar.gz.* | tar -xzvf -

数据结构

-

文件夹结构:

rdt_data/---task_1/---episode_1.hdf5 | | |-task_2/ |-episode_2.hdf5 | | |-task_3/ |-... | | |-... |-expanded_instruction_gpt-4-turbo.json

-

HDF5文件:

observations:qpos: 两个机械臂的关节位置,形状为 (TRAJ_LEN, 14);第七和第十四个关节是夹持器关节角度images:cam_high: 外部摄像头在每个时间步的RGB图像,形状为 (TRAJ_LEN, 480, 640, 3)cam_left_wrist: 左腕摄像头在每个时间步的RGB图像,形状为 (TRAJ_LEN, 480, 640, 3)cam_right_wrist: 右腕摄像头在每个时间步的RGB图像,形状为 (TRAJ_LEN, 480, 640, 3)

action: 下一个时间步两个机械臂的期望关节位置,形状为 (TRAJ_LEN, 14);注意这与下一个时间步的实际关节位置略有不同

-

JSON文件:

instruction: 原始的人工标注指令,值为字符串expanded_instruction: 由GPT-4-Turbo扩展的指令,值为字符串列表simplified_instruction: 由GPT-4-Turbo简化的指令,值为字符串列表

注意事项

- HDF5文件的数量不一定连续。

TRAJ_LEN可能因片段而异。

AI搜集汇总

数据集介绍

构建方式

rdt-ft-data数据集是为双手机器人操作任务而构建的微调数据集,主要用于支持论文《RDT-1B: a Diffusion Foundation Model for Bimanual Manipulation》的研究。该数据集通过多模态数据采集方式构建,包含多个任务场景下的机器人操作轨迹数据。每个任务文件夹中存储了HDF5格式的轨迹文件,记录了机器人双臂的关节位置、外部摄像头及左右手腕摄像头的RGB图像,以及下一时间步的期望关节位置。此外,每个任务还配备了由人类标注的原始指令,并通过GPT-4-Turbo生成扩展和简化版本的指令,以增强数据的多样性和实用性。

特点

rdt-ft-data数据集的特点在于其多模态数据的丰富性和高质量标注。每个任务文件夹中的HDF5文件详细记录了机器人双臂的关节位置和多个视角的RGB图像,为双手机器人操作任务提供了全面的感知信息。同时,数据集中的指令文件不仅包含原始的人类标注指令,还通过GPT-4-Turbo生成了扩展和简化版本的指令,为模型训练提供了多样化的语言指导。这种多模态数据与高质量语言指令的结合,使得该数据集在机器人操作任务的研究中具有重要的应用价值。

使用方法

使用rdt-ft-data数据集时,用户需首先下载所有压缩文件,并通过命令行工具解压。解压后,数据集以任务为单位组织,每个任务文件夹中包含多个HDF5格式的轨迹文件和对应的指令JSON文件。HDF5文件记录了机器人操作轨迹的多模态数据,包括关节位置和摄像头图像,而JSON文件则提供了任务的语言指令。用户可以根据任务需求加载相应的HDF5文件和指令文件,用于模型训练或评估。该数据集的结构设计简洁明了,便于研究人员快速上手并应用于双手机器人操作任务的研究中。

背景与挑战

背景概述

rdt-ft-data数据集是为支持论文《RDT-1B: a Diffusion Foundation Model for Bimanual Manipulation》而创建的微调数据集,发布于2024年。该数据集由清华大学机器学习研究团队开发,旨在推动双手机器人操作领域的研究。数据集的核心研究问题是通过扩散模型(Diffusion Model)提升双手机器人在复杂任务中的操作能力。该数据集不仅为机器人操作任务提供了丰富的多模态数据,还通过GPT-4-Turbo生成的语言指令扩展了任务的多样性和复杂性,为机器人学习与人类指令的交互提供了重要支持。其发布对机器人学、多模态学习及扩散模型的应用研究具有深远影响。

当前挑战

rdt-ft-data数据集在解决双手机器人操作任务中面临多重挑战。首先,双手机器人操作任务本身具有高度复杂性,涉及多关节协同控制、多视角感知及动态环境适应等问题。其次,数据集的构建过程中,如何高效采集并标注多模态数据(如关节位置、多视角图像及语言指令)是一个关键挑战。此外,生成高质量的语言指令扩展(如通过GPT-4-Turbo)需要确保指令的准确性和多样性,这对数据集的实用性和泛化能力提出了更高要求。最后,数据集的规模与多样性之间的平衡也是一个重要问题,如何在有限资源下覆盖更多任务场景仍需进一步探索。

常用场景

经典使用场景

在机器人学和多模态学习领域,rdt-ft-data数据集被广泛应用于双手机器人操作的微调任务。该数据集通过提供丰富的轨迹数据和语言指令,支持研究人员在仿真环境中训练和验证双手机器人操作的模型。每个任务文件夹中的HDF5文件包含了机器人手臂的关节位置和摄像头图像,而JSON文件则提供了详细的语言指令,使得模型能够在多模态输入下进行精确的操作学习。

实际应用

在实际应用中,rdt-ft-data数据集被用于开发智能机器人系统,特别是在工业自动化和服务机器人领域。通过利用该数据集中的多模态数据,研究人员能够训练出能够在复杂环境中执行精细操作的机器人系统。例如,在制造业中,双手机器人可以完成装配、焊接等任务;在医疗领域,机器人可以协助进行手术操作。这些应用不仅提高了生产效率,还降低了人工操作的错误率。

衍生相关工作

基于rdt-ft-data数据集,研究人员已经开展了多项经典工作。例如,RDT-1B模型利用该数据集进行了双手机器人操作的扩散模型训练,显著提升了模型在复杂任务中的表现。此外,该数据集还催生了一系列关于多模态学习和机器人操作的研究,如基于GPT-4-Turbo的指令扩展和简化方法,进一步推动了机器人操作任务的自动化和智能化。这些工作不仅扩展了数据集的应用范围,还为未来的研究提供了新的方向。

以上内容由AI搜集并总结生成