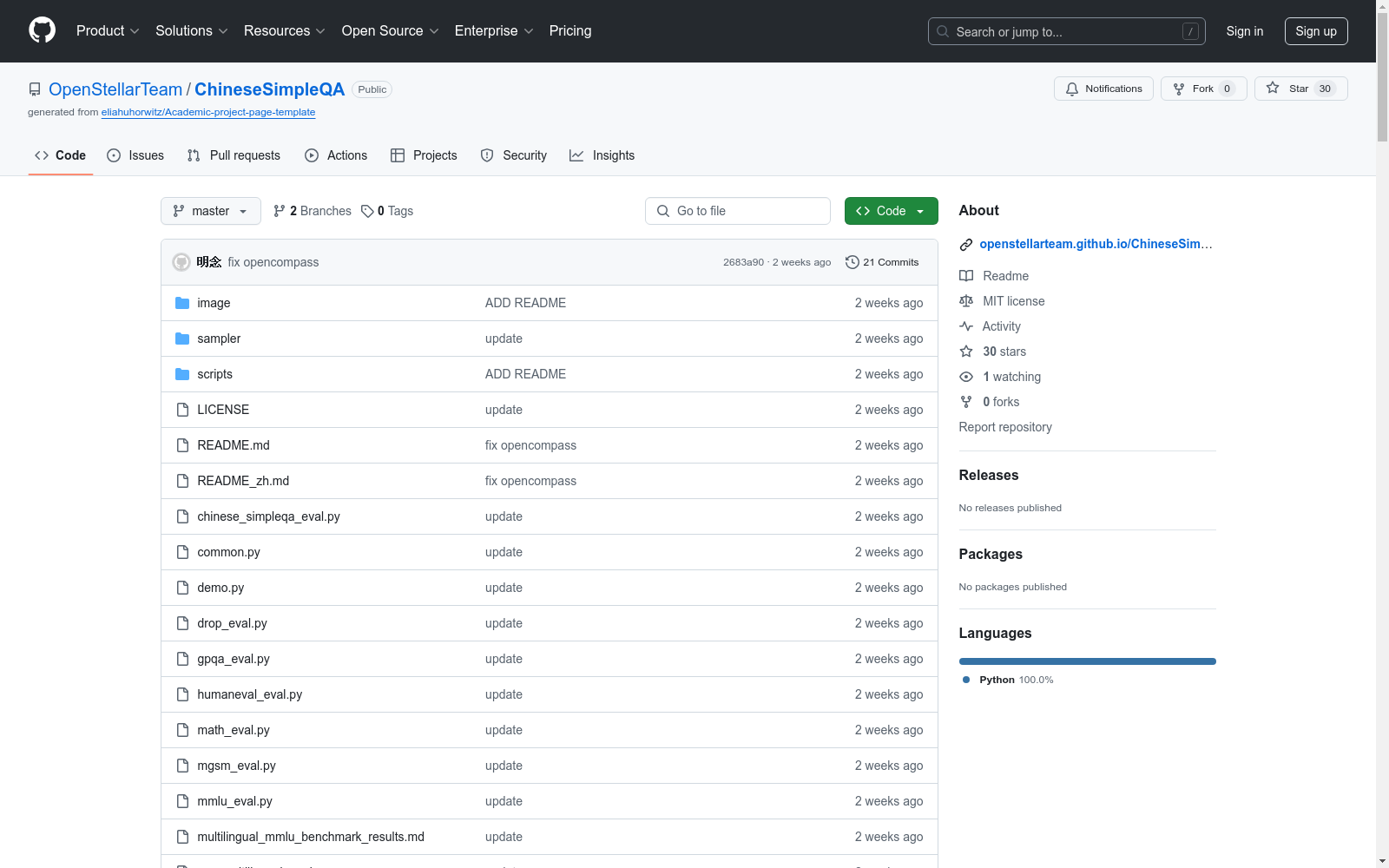

Chinese SimpleQA|语言模型评估数据集|中文问答数据集

收藏Chinese SimpleQA 数据集概述

数据集简介

Chinese SimpleQA 是一个综合性的中文基准测试数据集,用于评估语言模型回答简短问题的真实性能力。该数据集主要具有以下五个特性:

- 中文:专注于中文语言,全面评估现有大型语言模型(LLMs)在中文方面的真实性能力。

- 多样性:涵盖6个主要主题,包括“中国文化”、“人文”、“工程、技术和应用科学”、“生活、艺术和文化”、“社会”和“自然科学”,共计99个细分子主题。

- 高质量:通过全面且严格的质量控制流程,确保数据集的质量和准确性。

- 静态:所有参考答案不会随时间变化,保持数据集的常青特性。

- 易于评估:问题和答案都非常简短,可以通过现有的LLMs(如OpenAI API)快速运行评分程序。

数据集内容

- 主题覆盖:涵盖6个主要主题,包含99个细分子主题。

- 问题数量:包含3000个高质量问题,涉及从人文到科学工程的广泛领域。

数据集发布

- 发布时间:2024年11月12日

- 发布平台:已在Hugging Face上发布,地址为Hugging Face。

数据集使用

评估方法

数据集提供三种评估方法:

-

基于simple-evals的评估: bash python -m simple-evals.demo

-

自编写的简单单次评估脚本:

-

设置OpenAI API密钥: python os.environ["OPENAI_API_KEY"] = "replace your key here"

-

运行评估脚本: bash python scripts/chinese_simpleqa_easy.py

-

获取完整排行榜: bash python scripts/get_leaderboard.py

-

-

集成到OpenCompass的评估:

-

克隆OpenCompass: bash git clone git@github.com:open-compass/opencompass.git cd opencompass

-

下载Chinese SimpleQA数据并放置在指定路径:

~/opencompass/data/ └── chinese_simpleqa ├── chinese_simpleqa.jsonl

-

配置并启动评估: bash python run.py configs/eval_chinese_simpleqa.py

-

引用

如使用该数据集,请引用相关论文:

@misc{he2024chinesesimpleqachinesefactuality, title={Chinese SimpleQA: A Chinese Factuality Evaluation for Large Language Models}, author={Yancheng He and Shilong Li and Jiaheng Liu and Yingshui Tan and Weixun Wang and Hui Huang and Xingyuan Bu and Hangyu Guo and Chengwei Hu and Boren Zheng and Zhuoran Lin and Xuepeng Liu and Dekai Sun and Shirong Lin and Zhicheng Zheng and Xiaoyong Zhu and Wenbo Su and Bo Zheng}, year={2024}, eprint={2411.07140}, archivePrefix={arXiv}, primaryClass={cs.CL}, url={https://arxiv.org/abs/2411.07140}, }