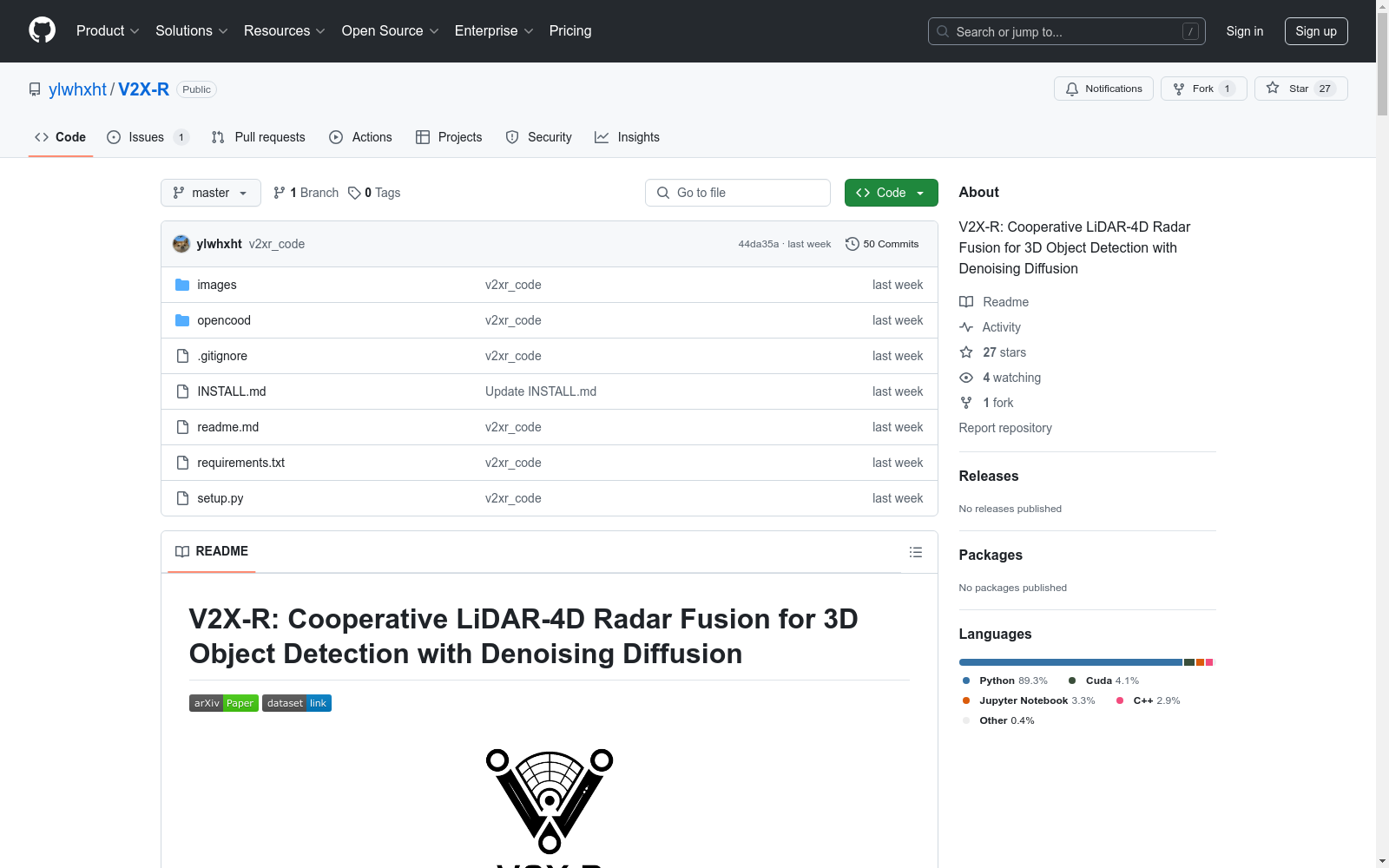

V2X-R|自动驾驶数据集|V2X通信数据集

收藏V2X-R 数据集概述

简介

V2X-R 是一个包含 LiDAR、相机和 4D 雷达的多模态数据集,专门用于 3D 目标检测。该数据集包含 12,079 个场景,共计 37,727 帧 LiDAR 和 4D 雷达点云数据,150,908 张图像,以及 170,859 个标注的 3D 车辆边界框。

数据集特点

-

多模态支持:

- LiDAR

- 4D 雷达

- LiDAR-4D 雷达融合

-

数据集支持:

- V2X-R

- OPV2V

- DAIR-V2X

-

先进的协同感知方法支持:

- 晚融合

- 早融合

- When2com (CVPR2020)

- V2VNet (ECCV2020)

- PFA-Net (ITSC2021)

- RTNH (NIPS2022)

- DiscoNet (NeurIPS2021)

- V2X-ViT (ECCV2022)

- CoBEVT (CoRL2022)

- Where2comm (NeurIPS2022)

- CoAlign (ICRA2023)

- BM2CP (CoRL2023)

- SCOPE (ICCV2023)

- How2comm (NeurIPS2023)

- InterFusion (IROS2023)

- L4DR (Arxiv2024)

- SICP (IROS2024)

-

可视化支持:

- BEV 可视化

- 3D 可视化

数据集结构

数据集下载并解压后,结构如下: sh V2X-R # 根路径 ├── train │ ├── 序列名称(数据收集时间,例如 2024_06_24_20_24_02) │ │ ├── 代理编号("-1" 表示基础设施,否则为 CAVs) │ │ │ ├── 数据(包含以下类型的数据) │ │ │ │ 时间戳.类型,例如: │ │ │ │ - 000060_camerai.png(第 i 个相机) │ │ │ │ - 000060.pcd(LiDAR) │ │ │ │ - 000060_radar.pcd(4D 雷达) │ │ │ │ - 000060_fog.pcd(雾模拟 LiDAR) │ │ │ │ - 000060_snow.pcd(雪模拟 LiDAR) │ │ │ │ - 000060.yaml(雾模拟 LiDAR) ├── validate │ ├── ... ├── test │ ├── ...

数据集下载与解压

- 下载链接:http://39.98.109.195:1000/

- 用户名:Guest

- 密码:guest_CMD

数据集包含大量数据(每个代理包含 3x LiDAR{正常、雾、雪}、1x 雷达、4x 图像),已压缩为序列数据。下载后可参考以下代码进行批量解压: python import os import subprocess def decompress_v2x_r(root_dir, save_dir): for root, dirs, files in os.walk(root_dir): for file in files: if file.endswith(.7z): file_path = os.path.join(root, file) path = root.split(/) extract_path = os.path.join(save_dir, path[-2], path[-1], file[:-3]) os.makedirs(extract_path, exist_ok=True) subprocess.run([7z, x, -o + extract_path + /, file_path])

data_directory = # 下载的数据集路径,例如:/mnt/16THDD-2/hx/V2X-R_Dataset(compressed) output_directory = # 输出数据集路径,例如:/mnt/16THDD-2/hx/t decompress_v2x_r(data_directory, output_directory)

数据集校准

数据集提供每个传感器(LiDAR、4D 雷达、相机)的校准信息,用于传感器间融合。特别地,4D 雷达点云数据已预先转换为对应代理的 LiDAR 坐标系统,因此 4D 雷达点云参考 LiDAR 坐标系统。