FIReStereo

收藏arXiv2024-09-12 更新2024-09-14 收录

下载链接:

https://firestereo.github.io

下载链接

链接失效反馈官方服务:

资源简介:

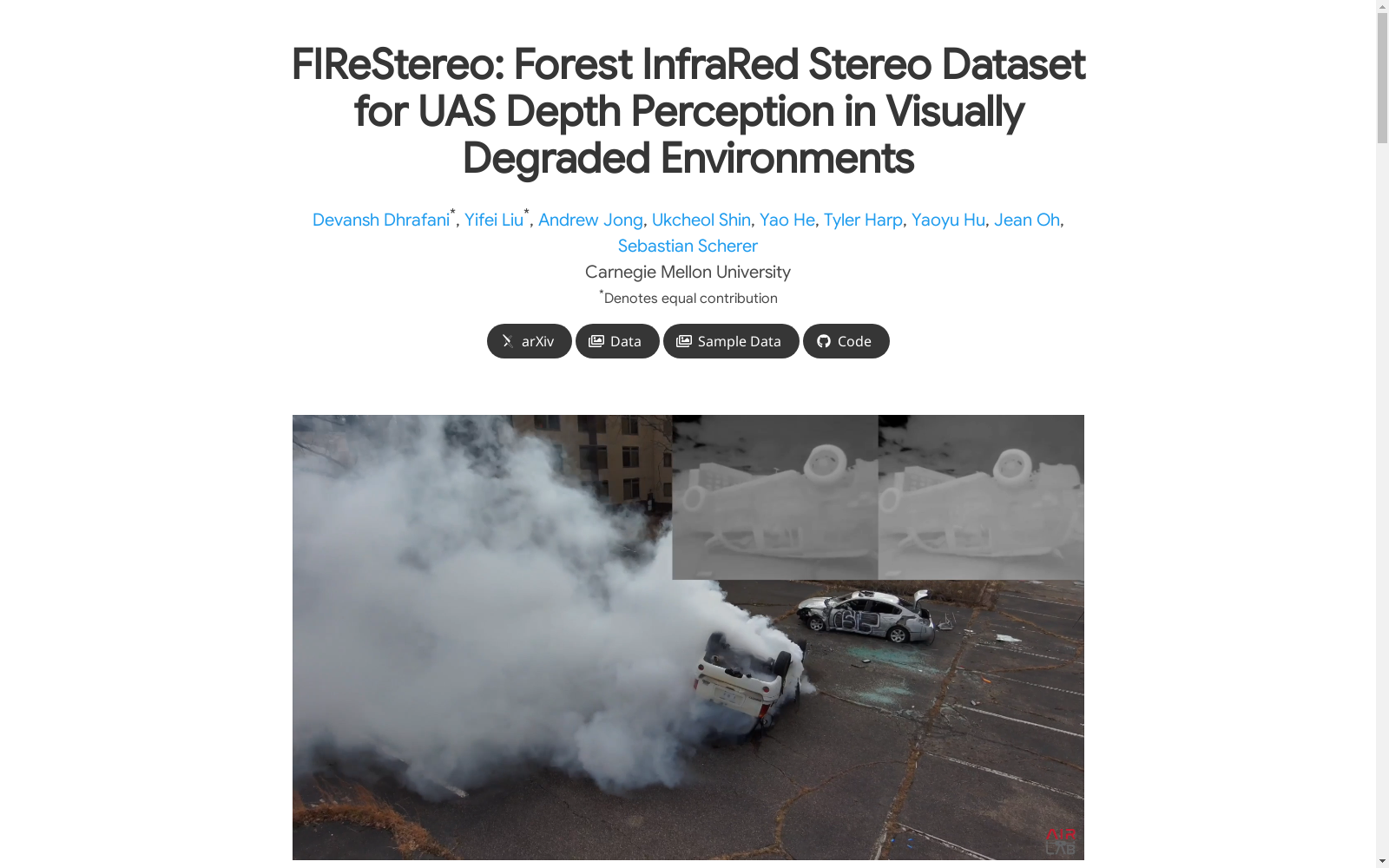

FIReStereo数据集由卡内基梅隆大学的研究团队创建,旨在为无人机的深度感知提供支持,特别是在视觉受损的环境中。该数据集包含204,594对立体红外图像,以及LiDAR、IMU和地面真值深度图,采集于城市和森林环境中,涵盖了白天、夜晚、雨天和烟雾等多种条件。数据集的创建过程包括在不同环境中进行数据采集,并使用Faster-LIO算法进行深度图的密集化处理。该数据集主要应用于灾难场景中的机器人感知,帮助无人机在烟雾等视觉受损环境中进行探索和操作。

The FIReStereo dataset was created by a research team from Carnegie Mellon University, with the goal of supporting depth perception for unmanned aerial vehicles (UAVs), especially in visually degraded environments. This dataset includes 204,594 pairs of stereo infrared images, as well as LiDAR, IMU, and ground-truth depth maps, and was collected across urban and forest environments, covering diverse conditions such as daytime, nighttime, rainy weather, and smoke. The dataset development process involves data collection in various environments and the densification of depth maps using the Faster-LIO algorithm. This dataset is mainly applied to robotic perception in disaster scenarios, helping UAVs conduct exploration and operation in visually degraded environments like those filled with smoke.

提供机构:

卡内基梅隆大学

创建时间:

2024-09-12

搜集汇总

数据集介绍

构建方式

FIReStereo数据集通过在城市和森林环境中,利用无人机(UAS)搭载的立体红外热成像相机、激光雷达(LiDAR)和惯性测量单元(IMU)进行数据采集。数据集涵盖了多种环境条件,包括白天、夜晚、雨天和烟雾环境。为了确保数据的多样性和代表性,数据采集过程中模拟了森林城市交界处的复杂环境,特别是针对烟雾环境下的深度感知需求。通过这些传感器的数据同步和校准,FIReStereo数据集提供了高质量的立体热成像图像和相应的深度图,为研究在视觉退化环境中的深度感知提供了宝贵的资源。

特点

FIReStereo数据集的显著特点在于其针对视觉退化环境的高适应性,特别是在烟雾和低光照条件下。数据集包含了多种环境类型和天气条件,如城市、混合和野外环境,以及白天、夜晚、雨天和烟雾等不同条件。此外,数据集中的传感器数据(包括立体热成像、LiDAR和IMU)均经过精确的时间同步,确保了数据的一致性和可靠性。这些特点使得FIReStereo数据集成为开发和验证在复杂环境中深度感知算法的理想选择。

使用方法

FIReStereo数据集适用于开发和验证在视觉退化环境中的深度感知算法,特别是针对无人机(UAS)的应用。研究者可以使用该数据集训练和测试立体深度估计模型,评估其在不同环境条件下的性能。数据集提供了丰富的传感器数据,包括立体热成像图像、LiDAR数据和IMU信息,这些数据可以用于多种任务,如深度估计、SLAM(同时定位与地图构建)和路径规划。通过使用FIReStereo数据集,研究者可以开发出更加鲁棒和精确的深度感知系统,以应对复杂和恶劣的环境条件。

背景与挑战

背景概述

在自主空中系统(UAS)领域,视觉退化环境中的鲁棒深度感知至关重要。传统传感器如激光雷达(LiDAR)和RGB相机在烟雾、灰尘和黑暗等条件下表现不佳。为此,FIReStereo数据集应运而生,由卡内基梅隆大学的研究人员于2024年创建,旨在为小型UAS提供在视觉退化环境中进行深度估计的数据支持。该数据集包含了在城市和森林环境中采集的立体热成像图像、LiDAR、IMU和地面真值深度图,涵盖了白天、夜晚、雨天和烟雾等多种条件。FIReStereo数据集的推出填补了相关领域的空白,为开发适用于复杂环境的深度感知算法提供了宝贵的资源,有望在灾害响应等场景中显著提升机器人的感知能力。

当前挑战

FIReStereo数据集的构建面临多重挑战。首先,视觉退化环境中的数据采集极具挑战性,需要在烟雾、黑暗等极端条件下确保传感器数据的准确性和一致性。其次,热成像数据的处理和校准复杂,尤其是立体热成像的同步和校准,需要高精度的技术支持。此外,数据集的多样性和代表性也是一个重要挑战,确保涵盖不同环境类型和天气条件,以提高模型的泛化能力。最后,如何在资源受限的UAS平台上实现高效的深度估计算法,也是一个亟待解决的问题。这些挑战不仅涉及数据采集和处理的技术难题,还包括算法优化和硬件适配的复杂性。

常用场景

经典使用场景

FIReStereo数据集在无人机的深度感知中展现了其经典应用场景。该数据集通过收集城市和森林环境中的立体红外图像、激光雷达(LiDAR)、惯性测量单元(IMU)和地面真实深度图,为在视觉降级环境中的深度估计提供了丰富的数据支持。这些数据在训练和评估立体深度估计算法时,特别是在烟雾、雨夜等复杂条件下,展现了其独特的优势。

实际应用

FIReStereo数据集在实际应用中展现了其广泛的应用场景。特别是在灾难响应中,无人机需要穿越烟雾、灰尘和黑暗等恶劣环境,进行人员搜救和场景评估。该数据集通过提供立体红外图像和相应的深度信息,帮助开发和验证能够在这些极端条件下工作的深度感知算法,从而提升无人机的实际操作能力和安全性。

衍生相关工作

FIReStereo数据集的发布催生了一系列相关研究工作。研究人员利用该数据集开发了多种立体深度估计模型,如Fast-ACVNet和MobileStereoNet,这些模型在计算效率和精度上都有显著提升。此外,该数据集还促进了红外视觉与惯性导航融合的研究,推动了轻量级立体匹配网络的设计,为无人机在复杂环境中的实时深度感知提供了新的技术路径。

以上内容由遇见数据集搜集并总结生成