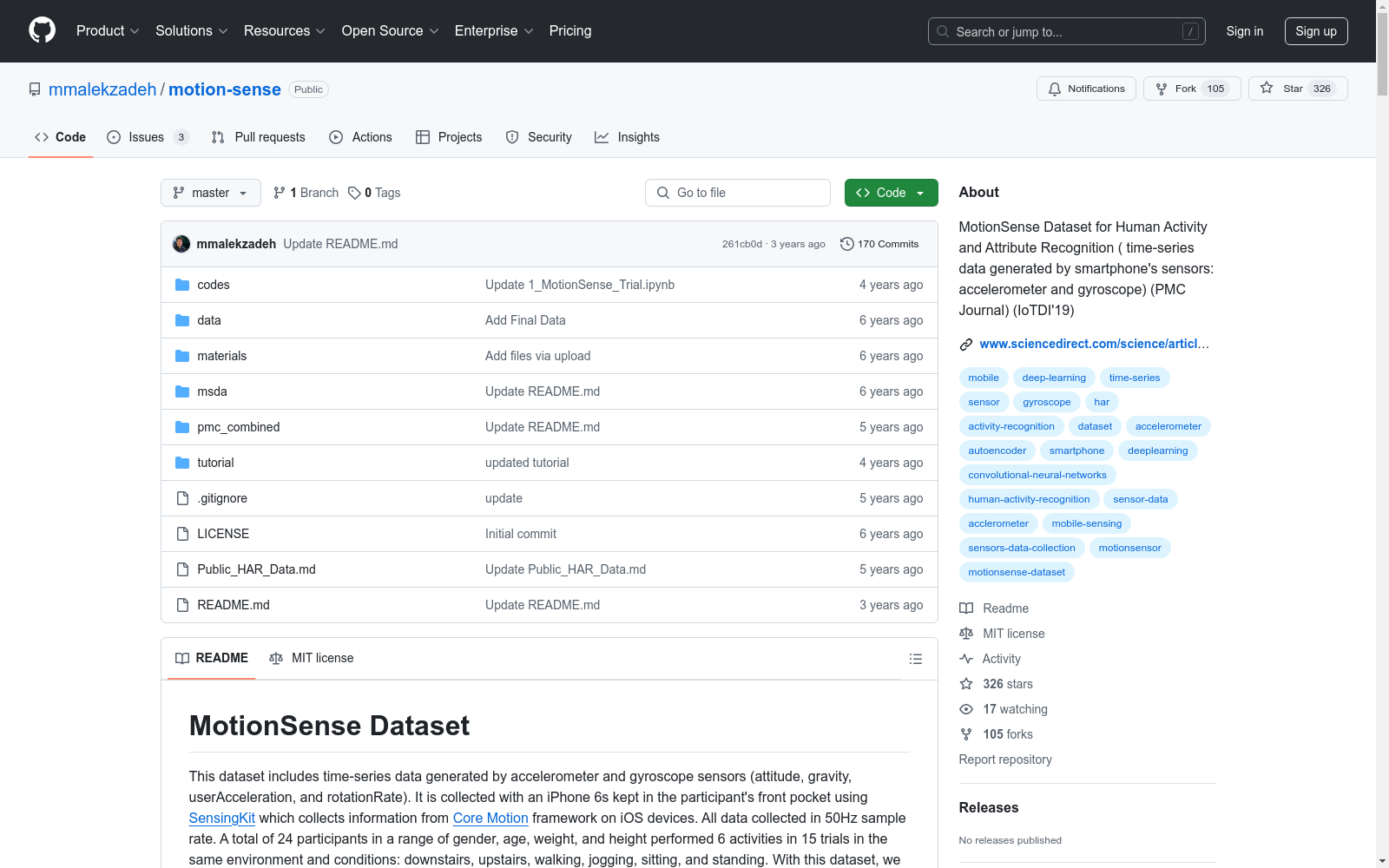

MotionSense HAR Dataset|人类活动识别数据集|传感器数据数据集

收藏

- MotionSense HAR Dataset首次发表,由Alaa Al-Zoubi等人提出,旨在通过智能手机传感器数据进行人体活动识别研究。

- 该数据集在多个学术会议和期刊上被引用,成为人体活动识别领域的重要基准数据集之一。

- MotionSense HAR Dataset被广泛应用于机器学习和数据挖掘领域的研究,特别是在深度学习模型中用于活动识别任务。

- 1MotionSense Dataset: Towards Activity Recognition from Smartphone-Embedded SensorsUniversity of Waterloo · 2019年

- 2Human Activity Recognition Using Smartphone Sensors: A Comprehensive SurveyUniversity of California, Irvine · 2020年

- 3Deep Learning for Human Activity Recognition: A ReviewUniversity of Surrey · 2021年

- 4A Comparative Study of Machine Learning Algorithms for Human Activity RecognitionUniversity of São Paulo · 2022年

- 5Transfer Learning for Human Activity Recognition Using MotionSense DatasetUniversity of Cambridge · 2023年

ROBEL

ROBEL是一个开源的低成本机器人平台,专为现实世界的强化学习设计。该平台由谷歌研究院和加州大学伯克利分校共同开发,包含两个机器人:D'Claw,一个三指手机器人,用于促进精细操作任务的学习;D'Kitty,一个四足机器人,用于促进敏捷的腿式移动任务学习。这些模块化机器人易于维护且足够坚固,能够承受从零开始的硬件强化学习,目前已记录超过14000小时的训练时间。ROBEL提供了一系列连续控制基准任务,这些任务具有密集和稀疏的任务目标,并引入了硬件安全评分指标。数据集和相关材料可在www.roboticsbenchmarks.org访问,旨在解决强化学习在真实机器人上的应用问题,特别是在处理物理限制和环境交互方面的挑战。

arXiv 收录

MIT Indoor Scenes

室内场景识别是高水平视觉中一个具有挑战性的开放性问题。大多数适用于室外场景的场景识别模型在室内领域的表现都较差。该数据库包含67个室内类别,共15620张图像。图像的数量因类别而异,但每个类别至少有100张图像。所有图像均为jpg格式。此处提供的图像仅用于研究目的。

阿里云天池 收录

长江干流实时水位观测数据集(2024年)

该数据集为长江干流主要水文站实时水位观测数据集,包含了汉口、户口、九江、宜昌等16个水文站点的逐小时或逐日水位观测数据。 该数据集包含3个excel表格文件,长江干流站点.xls,逐日水位.xlsx,逐小时水位.xlsx。

国家地球系统科学数据中心 收录

AgiBot World

为了进一步推动通用具身智能领域研究进展,让高质量机器人数据触手可及,作为上海模塑申城语料普惠计划中的一份子,智元机器人携手上海人工智能实验室、国家地方共建人形机器人创新中心以及上海库帕思,重磅发布全球首个基于全域真实场景、全能硬件平台、全程质量把控的百万真机数据集开源项目 AgiBot World。这一里程碑式的开源项目,旨在构建国际领先的开源技术底座,标志着具身智能领域 「ImageNet 时刻」已到来。AgiBot World 是全球首个基于全域真实场景、全能硬件平台、全程质量把控的大规模机器人数据集。相比于 Google 开源的 Open X-Embodiment 数据集,AgiBot World 的长程数据规模高出 10 倍,场景范围覆盖面扩大 100 倍,数据质量从实验室级上升到工业级标准。AgiBot World 数据集收录了八十余种日常生活中的多样化技能,从抓取、放置、推、拉等基础操作,到搅拌、折叠、熨烫等精细长程、双臂协同复杂交互,几乎涵盖了日常生活所需的绝大多数动作需求。

github 收录

Amazon Product Data

该数据集包含亚马逊产品的详细信息,包括产品规格、价格、折扣、客户评价和用户评分等字段。

github 收录