NAVCON|视觉语言导航数据集|机器人导航数据集

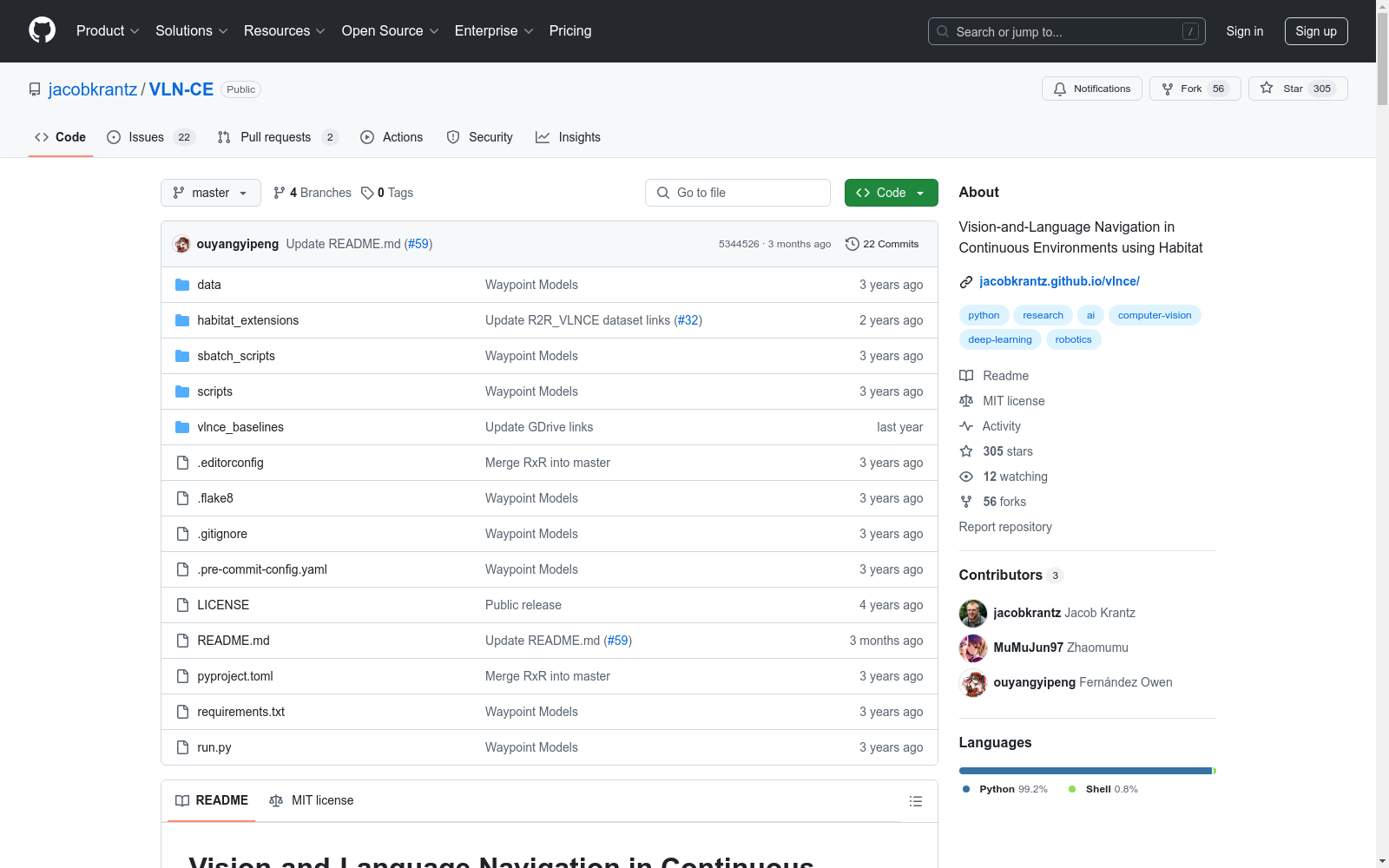

收藏Vision-and-Language Navigation in Continuous Environments (VLN-CE)

数据集概述

VLN-CE 是一个基于指令的导航任务,包含众包指令、真实环境以及不受限制的代理导航。该数据集支持 Room-to-Room (R2R) 和 Room-Across-Room (RxR) 数据集。

场景数据

- Matterport3D (MP3D):使用 Matterport3D 场景重建数据。场景数据可以通过 Matterport3D 的官方下载脚本获取,并解压到

data/scene_datasets/mp3d/{scene}/{scene}.glb路径下,共有 90 个场景。

任务数据

Room-to-Room (R2R)

- R2R_VLNCE_v1-3:R2R_VLNCE_v1-3 是 Room-to-Room (R2R) 数据集的移植版本,适用于 Matterport3DSimulator (MP3D-Sim)。数据集包含

R2R_VLNCE_v1-3和R2R_VLNCE_v1-3_preprocessed两个版本。- R2R_VLNCE_v1-3.zip:3 MB,解压路径为

data/datasets/R2R_VLNCE_v1-3。 - R2R_VLNCE_v1-3_preprocessed.zip:250 MB,解压路径为

data/datasets/R2R_VLNCE_v1-3_preprocessed。

- R2R_VLNCE_v1-3.zip:3 MB,解压路径为

Room-Across-Room (RxR)

- RxR_VLNCE_v0.zip:RxR 数据集包含多语言指令(英语、印地语、泰卢固语),路径多样,适用于连续环境。数据集包含

train、val_seen、val_unseen和test_challenge四个分割,结构如下: graphql data/datasets ├─ RxR_VLNCE_v0 | ├─ train | | ├─ train_guide.json.gz | | ├─ train_guide_gt.json.gz | | ├─ train_follower.json.gz | | ├─ train_follower_gt.json.gz | ├─ val_seen | | ├─ val_seen_guide.json.gz | | ├─ val_seen_guide_gt.json.gz | | ├─ val_seen_follower.json.gz | | ├─ val_seen_follower_gt.json.gz | ├─ val_unseen | | ├─ val_unseen_guide.json.gz | | ├─ val_unseen_guide_gt.json.gz | | ├─ val_unseen_follower.json.gz | | ├─ val_unseen_follower_gt.json.gz | ├─ test_challenge | | ├─ test_challenge_guide.json.gz | ├─ text_features | | ├─ ...

预训练模型权重

- ResNet 预训练权重:用于深度观察的 ResNet 预训练模型权重可以从 这里 下载,解压到

data/ddppo-models/{model}.pth。

数据集使用

安装依赖

- Python 3.6:建议使用 miniconda 或 anaconda 创建环境。

- Habitat-Sim 0.1.7:可以通过 conda 安装或从源码构建。

- Habitat-Lab 0.1.7:从源码安装。

数据集下载

- Matterport3D:使用

download_mp.py脚本下载场景数据。 - R2R_VLNCE_v1-3:通过

gdown命令下载。 - RxR_VLNCE_v0.zip:直接下载。

数据集结构

- R2R_VLNCE_v1-3:包含训练、验证和测试集。

- RxR_VLNCE_v0:包含多语言指令和轨迹数据。

引用

如果使用 VLN-CE 数据集,请引用以下论文:

tex @inproceedings{krantz_vlnce_2020, title={Beyond the Nav-Graph: Vision and Language Navigation in Continuous Environments}, author={Jacob Krantz and Erik Wijmans and Arjun Majundar and Dhruv Batra and Stefan Lee}, booktitle={European Conference on Computer Vision (ECCV)}, year={2020} }

如果使用 RxR-Habitat 数据,请额外引用以下论文:

tex @inproceedings{ku2020room, title={Room-Across-Room: Multilingual Vision-and-Language Navigation with Dense Spatiotemporal Grounding}, author={Ku, Alexander and Anderson, Peter and Patel, Roma and Ie, Eugene and Baldridge, Jason}, booktitle={Proceedings of the 2020 Conference on Empirical Methods in Natural Language Processing (EMNLP)}, pages={4392--4412}, year={2020} }

- 1NAVCON: A Cognitively Inspired and Linguistically Grounded Corpus for Vision and Language Navigation宾夕法尼亚大学 · 2024年