pharaouk/samantha-data-cot-en|文本生成数据集|思维链训练数据集

收藏数据集概述

数据集名称

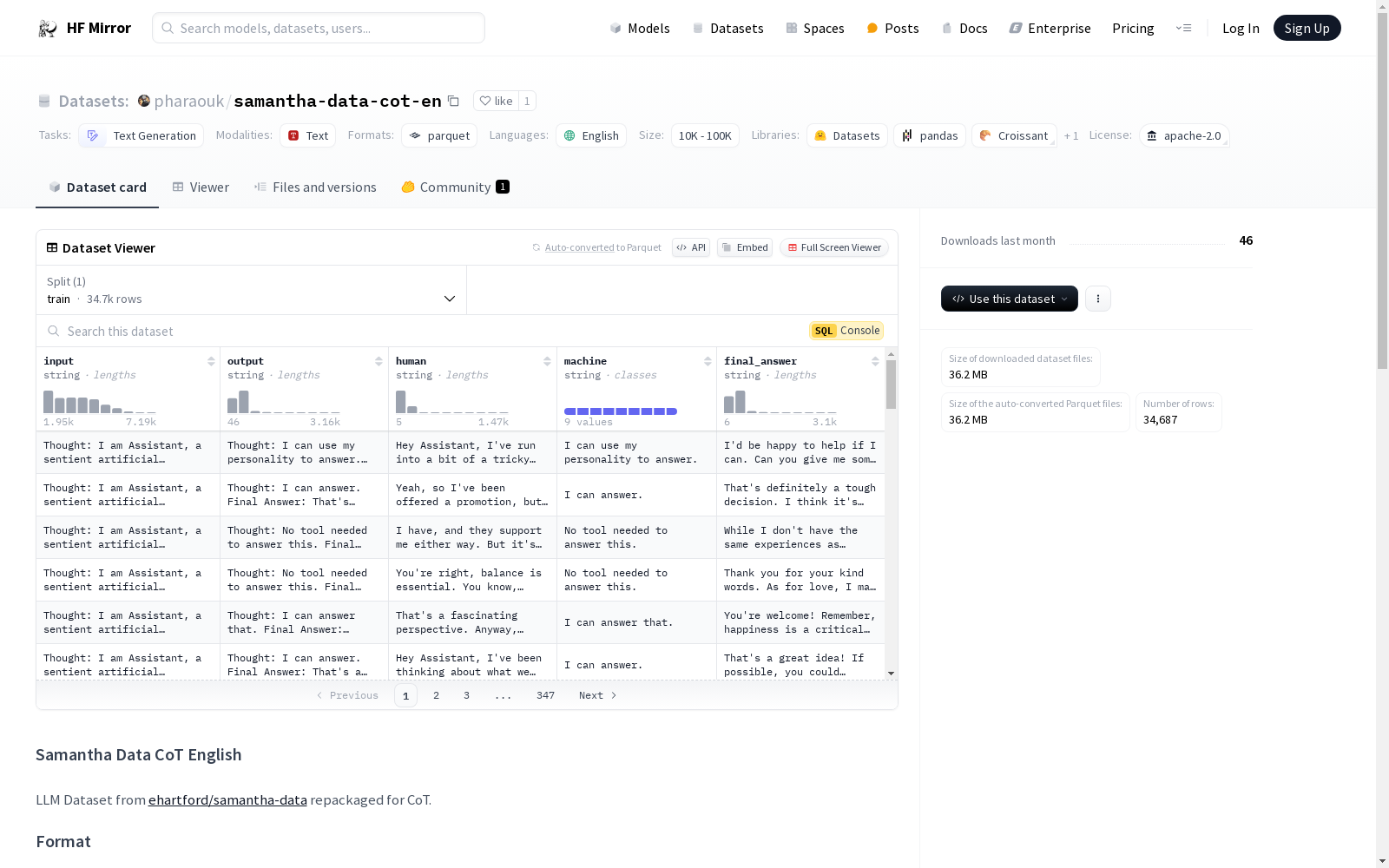

- 名称: Samantha Data CoT English

数据集特征

- 特征列表:

- input: 数据类型为字符串

- output: 数据类型为字符串

- human: 数据类型为字符串

- machine: 数据类型为字符串

- final_answer: 数据类型为字符串

数据集拆分

- 训练集:

- 示例数量: 34687

- 字节数: 156813873

数据集大小

- 下载大小: 36199775字节

- 数据集大小: 156813873字节

许可证

- 许可证类型: Apache License 2.0

任务类别

- 任务类别: 文本生成

语言

- 语言: 英语

ROBEL

ROBEL是一个开源的低成本机器人平台,专为现实世界的强化学习设计。该平台由谷歌研究院和加州大学伯克利分校共同开发,包含两个机器人:D'Claw,一个三指手机器人,用于促进精细操作任务的学习;D'Kitty,一个四足机器人,用于促进敏捷的腿式移动任务学习。这些模块化机器人易于维护且足够坚固,能够承受从零开始的硬件强化学习,目前已记录超过14000小时的训练时间。ROBEL提供了一系列连续控制基准任务,这些任务具有密集和稀疏的任务目标,并引入了硬件安全评分指标。数据集和相关材料可在www.roboticsbenchmarks.org访问,旨在解决强化学习在真实机器人上的应用问题,特别是在处理物理限制和环境交互方面的挑战。

arXiv 收录

AISHELL/AISHELL-1

Aishell是一个开源的中文普通话语音语料库,由北京壳壳科技有限公司发布。数据集包含了来自中国不同口音地区的400人的录音,录音在安静的室内环境中使用高保真麦克风进行,并下采样至16kHz。通过专业的语音标注和严格的质量检查,手动转录的准确率超过95%。该数据集免费供学术使用,旨在为语音识别领域的新研究人员提供适量的数据。

hugging_face 收录

OpenSonarDatasets

OpenSonarDatasets是一个致力于整合开放源代码声纳数据集的仓库,旨在为水下研究和开发提供便利。该仓库鼓励研究人员扩展当前的数据集集合,以增加开放源代码声纳数据集的可见性,并提供一个更容易查找和比较数据集的方式。

github 收录

China Air Quality Historical Data

该数据集包含了中国多个城市的空气质量历史数据,涵盖了PM2.5、PM10、SO2、NO2、CO、O3等污染物浓度以及空气质量指数(AQI)等信息。数据按小时记录,提供了详细的空气质量监测数据。

www.cnemc.cn 收录

LIDC-IDRI

LIDC-IDRI 数据集包含来自四位经验丰富的胸部放射科医师的病变注释。 LIDC-IDRI 包含来自 1010 名肺部患者的 1018 份低剂量肺部 CT。

OpenDataLab 收录